(通讯员:王砾伟)近日,第20届国际计算机视觉大会(The 20th IEEE/CVF International Conference on Computer Vision,ICCV 2025)公布论文接收结果,我校计算机学院、智能机器人湖北省重点实验室、多模态感知与认知计算团队的研究成果被大会录用。论文题为《End-to-End Entity-Predicate Association Reasoning for Dynamic Scene Graph Generation》(端到端实体-谓词关联推理的动态场景图生成)。第一作者为张彦铎教授指导的博士研究生王砾伟,第一署名单位为武汉工程大学。

该研究获得国家自然科学基金(62171328,62072350,62171327),湖北省自然科学基金重点项目-襄阳创新发展联合基金(2025AFD050)、湖北省高等学校优秀中青年科技创新团队(T2023009)的资助,旨在解决计算机视频处理中复杂动态信息的解析难题,聚焦于动态场景图生成这一前沿领域。动态场景图生成的目标是从视频中提取主体、对象及其视觉关系,并构建图结构表示,让计算机能像人类一样“理解”视频内容。由于动态场景图存在复杂的时间依赖和视觉关系的长尾分布,因此极具挑战性。

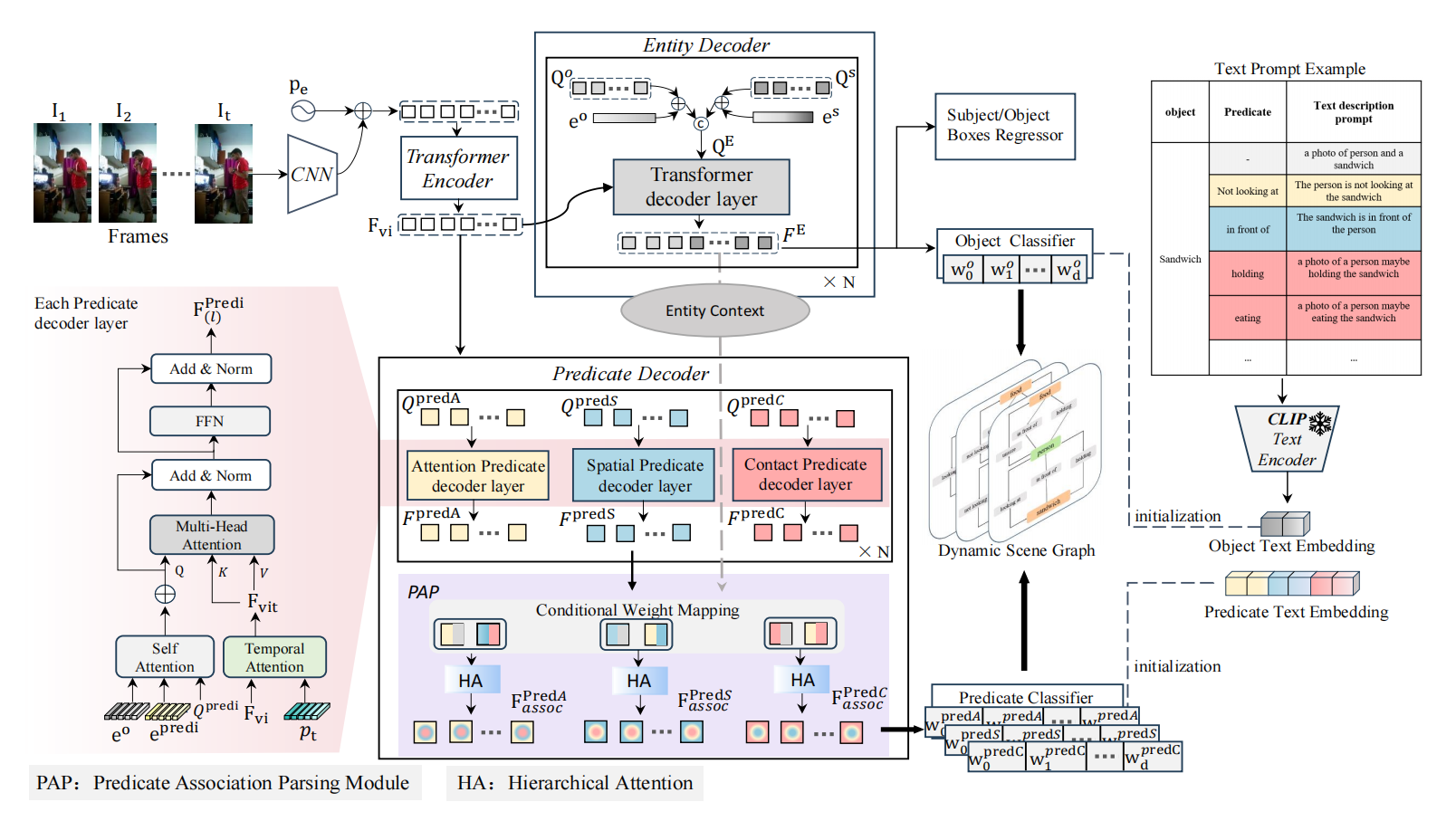

针对现有方法主要关注捕获时间依赖而忽略实体与谓词之间的视觉依赖关系,多模态感知与认知计算团队首次提出了端到端的关联推理网络(如图1所示)。该网络设计了一个谓词关联解析模块,用于挖掘实体-谓词之间的关联线索;并通过一个分层注意力机制,将时空上下文信息聚合到实体和谓词表示中,实现有效的关联推理。同时,利用CLIP为模型注入鲁棒的语义先验信息,以促进端到端学习,缓解了因数据长尾分布而导致的谓词预测性能瓶颈问题。论文提出的方法在权威数据集 Action Genome上取得了领先性能,为视频信息的智能处理开辟了新的技术路径。

图1 网络框架图

国际计算机视觉大会(International Conference on Computer Vision,ICCV)由 IEEE 与 CVF 联合主办,是计算机视觉领域公认的顶级会议,与 CVPR、ECCV 并称为 “计算机视觉领域的三大顶会”。其论文集在谷歌学术全球出版物影响力榜单中位列第13位,被中国计算机学会(CCF)列为A类会议。该会议每两年举办一次,汇聚全球顶尖学者、研究人员及行业专家。ICCV 2025将于10月19日至23日在美国夏威夷檀香山会议中心召开。此次入选是我校首次以第一署名单位在计算机视觉三大顶会上发表论文。(审稿 张炜、周华兵)